视频翻译软件的核心原理是:根据视频中的说话声音识别出文字,然后将文字翻译为目标语言文字,再将翻译后的文字进行配音,最后将配音、文字嵌入视频。

可以看到第一步就是从视频中的说话声识别出文字,识别精确度直接影响到后续翻译和配音。

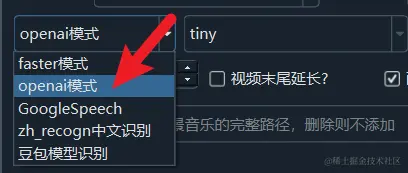

openai-whisper(本地) 语音识别渠道

该模式是OpenAI官方开源的whisper模型,相比faster-whisper速度较慢,但准确度略高一些。

模型选择

第一次使用某个模型时,将自动从 openai-whipser 的官方cdn下载

tiny --> base --> small --> medium --> large-v3-turbo --> large-v1 --> large-v2 --> large-v3

从前到后模型尺寸越来越大,识别精确度也越来越高,需要的内存和显存也越来越多。

建议至少选择大于等于large-v3-turbo的模型,效果最佳的模型是large-v3

该渠道最佳配置

为达到最佳语音识别效果,请参考以下设置

- 模型选择

large-v3(确保计算机内存大于16G 或 显存大于10G ),若不满足可尝试使用large-v1/large-v3-turbo模型. - 明确指定发音语言,确保和视频中语音所用语言一致

- 菜单-工具-高级选项-语音识别参数 区域:将

最短语音持续毫秒设为 1000 ,最长语音持续秒数设为大于等于 5 的值,不要选中Whisper预分割音频

此处需注意,如果你需要配音并且配音角色是

clone,即克隆原始发音音色进行配音,那么强烈建议将最短语音持续毫秒设为 3000 ,将最长语音持续秒数设为 10 ,因为 语音克隆时会自动将字幕时长对应的原始语音片段作为参考音频,而多数配音渠道均要求该参考音频时长在 3-10s 之间,否则配音很可能失败。 同时应该选中Whisper预分割音频以及合并过短字幕到相邻,以确保字幕时长能够落在 3-10s 之间

- 如果原始语音不够清晰或者有噪声,请选中 降噪

- 如果你不使用

clone角色,并且希望识别后的字幕尽可能短小,以便适配竖版视频,可适当降低最长语音持续秒数,例如设为 3 或 2. 如果有配音的话,可同时选中二次识别。

二次识别: 在选择配音并选择了嵌入单字幕时,选中二次识别意味着,将在配音完毕后再次对配音后的音频文件进行语音转录,生成较为简短的字幕嵌入视频内,确保字幕和配音精确对齐

CUDA 加速

为加快任务速度,在Windows和Linux上,如果有英伟达显卡,可配置安装CUDA和cuDNN环境后,启用CUDA加速,将能明显提高执行速度。